- Autor Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:42.

- Zuletzt bearbeitet 2025-01-22 17:14.

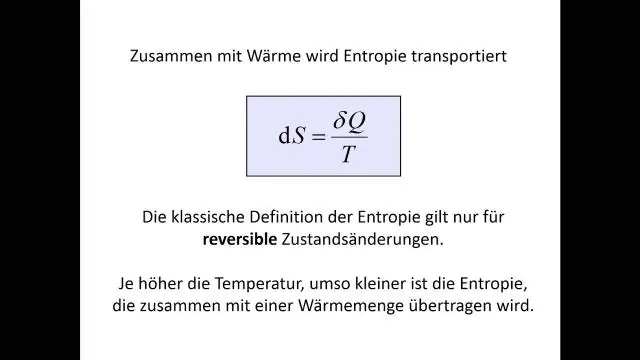

Entropie ist definiert als: Entropie ist die Summe der Wahrscheinlichkeit jedes Labels mal der logarithmischen Wahrscheinlichkeit desselben Labels. Wie kann ich mich bewerben Entropie und maximal Entropie bezüglich Text-Mining ?

Die Frage ist auch, was ist Entropie beim Data Mining?

Entropie . Ein Entscheidungsbaum wird von oben nach unten von einem Wurzelknoten aufgebaut und beinhaltet die Partitionierung der Daten in Teilmengen, die Instanzen mit ähnlichen Werten enthalten (homogen). ID3-Algorithmus verwendet Entropie um die Homogenität einer Probe zu berechnen.

Was ist außerdem die Definition von Entropie beim maschinellen Lernen? Entropie , in Bezug auf maschinelles Lernen , ist ein Maß für die Zufälligkeit der verarbeiteten Informationen. Je höher die Entropie , desto schwieriger ist es, aus diesen Informationen Schlussfolgerungen zu ziehen. Das Werfen einer Münze ist ein Beispiel für eine Aktion, die zufällige Informationen liefert. Das ist die Essenz von Entropie.

Die Leute fragen auch, was ist die Definition von Entropie im Entscheidungsbaum?

Nasir Islam Sujan. 29.06.2018 · 5 Min. Lesezeit. Laut Wikipedia, Entropie bezieht sich auf Unordnung oder Unsicherheit. Definition : Entropie ist das Maß für Unreinheit, Unordnung oder Unsicherheit in einer Reihe von Beispielen.

Wie berechnet man Entropie und Gewinn?

Informationsgewinn ist berechnet für eine Aufteilung durch Subtrahieren der gewichteten Entropien jedes Zweigs vom Original Entropie . Beim Trainieren eines Entscheidungsbaums mit diesen Metriken wird die beste Aufteilung durch Maximieren ausgewählt Informationsgewinn.

Empfohlen:

Was ist Speicherverlust beim Testen?

In einfacher Sprache ist ein Speicherverlust der Verlust von verfügbarem Speicher, wenn ein Programm keinen Speicher zurückgibt, den es zur vorübergehenden Verwendung erhalten hat. Ein Speicherleck ist das Ergebnis eines Programmierfehlers, daher ist es sehr wichtig, es während der Entwicklungsphase zu testen

Was ist Übergeneralisierung beim Schreiben?

Eine Übergeneralisierung ist eine Art logischer Fehlschluss, bei dem es sich um einen Denkfehler handelt. Das ist eine Übergeneralisierung, ein Denkfehler. Genauer gesagt könnten wir es so definieren, wenn ein Autor eine Behauptung aufstellt, die so weit gefasst ist, dass sie weder bewiesen noch widerlegt werden kann

Was ist die Definition von Entropie im Entscheidungsbaum?

Entropie: Ein Entscheidungsbaum wird von oben nach unten von einem Wurzelknoten aufgebaut und beinhaltet die Partitionierung der Daten in Teilmengen, die Instanzen mit ähnlichen Werten (homogen) enthalten. ID3-Algorithmus verwendet Entropie, um die Homogenität einer Probe zu berechnen

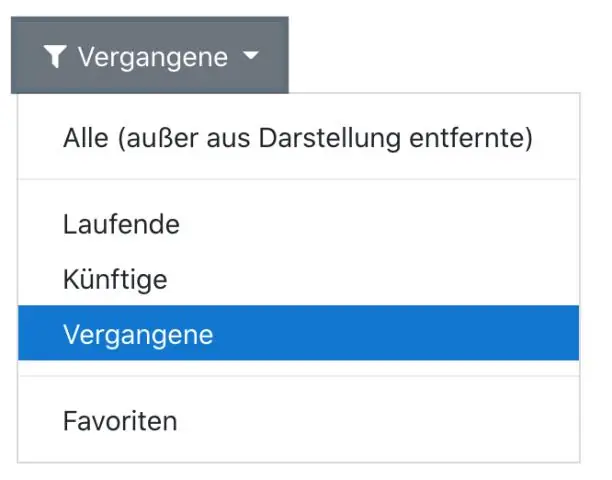

Wie öffne ich das Bootstrap-Dropdown-Menü beim Klicken statt beim Hovern?

Antwort: Verwenden Sie die jQuery-Methode hover() Um das Dropdown-Menü in Bootstrap zu öffnen oder anzuzeigen, müssen Sie standardmäßig auf das Triggerelement klicken. Wenn Sie jedoch das Dropdown-Menü beim Mouseover anstelle des Klickens anzeigen möchten, können Sie dies mit wenigen Anpassungen mit CSS und jQuery tun

Was ist Entropie-Informationsgewinn?

Informationsgewinn = wie viel Entropie wir entfernt haben. Das macht also Sinn: höherer Informationsgewinn = mehr Entropie entfernt, was wir wollen. Im perfekten Fall würde jeder Zweig nach der Aufspaltung nur eine Farbe enthalten, was Null Entropie wäre